엔지니어링 팀은 '혁신'을, 재무팀은 '0' 하나 줄이기를 원한다.

점심시간, 후드티를 입은 엔지니어들 사이로 재무팀 팀장이 나타난다면 인턴은 “어제 회식비가 너무 많이 나왔나?” 싶겠지만 옆 책상 엔지니어 리드는 직감적으로 안다. 또 비용 이야기.

핀테크 회사는 혁신과 비용 - 두 목표를 동시에 만족시키지 못하면 규제, 금리, AI적용 속도까지 한꺼번에 발목을 잡힐 수 있다. AI + Couchbase 조합은 TCO를 절감하면서도 비즈니스 크리티컬 워크로드를 실시간으로 처리하는 선택지가 될 수 있음.

바쁜 CEO와 엔지니어들 위해서 "실제로 얼마나, 어떻게 절감되는가?"를 냉정하게 정리해봤다.

매달 데이터베이스에 얼마를 태우고 있나?

분산된 아키텍처의 진짜 문제는 라이선스 비용만이 있는게 아님.

Redis(캐시) + PostgreSQL(거래) + Elasticsearch(로그) + Snowflake(분석) 이런 식으로 쪼개놓은 순간, 각각의 운영비·인건비·장애 대응비가 따로 논다. 데이터 동기화 실패하면 새벽 3시에 깨는 건 덤이고.

특히 핀테크는 독특한 것 같다. 금감원 검사 때 "데이터 증명하세요" 하면 시스템 다 찾아야 하고, DSS 컴플라이언스 위해 시스템별로 보안 인증 받느라 몇 달씩 날린다고함.

KYC 실시간 검증하려면 밀리초 응답이 필요한데, 사기 탐지 AI까지 돌리려니 또 다른 준비가 필요하고... 결국 엔지니어 한 팀이 여러가지를 동시에 저글링해야 하는 상황.

우리 인프라 비용의 10-15%가 시스템 간 연동과 중복 저장 때문이라면?

거래량은 그대로인데 데이터 복사본만 늘어나는 웃픈 상황아닐까.

비용은 줄이되 성능·컴플라이언스를 잃지 않는다.

Couchbase Capella의 진짜 매력은 "스택 다이어트"다.

동일한 JSON 기반 코드로 온프렘(금융데이터)과 클라우드(마케팅데이터)를 동시에 굴릴 수 있어서, 규제 때문에 하이브리드가 불가피한 핀테크에겐 구세주가 될수도?

벡터 검색(AI 챗봇용) + 실시간 분석 + 인메모리 캐시(거래처리)를 한 플랫폼에서 처리하니까, 기존에 Redis + Elastic + PostgreSQL 여러 곳에서 관리하던 걸 1개 팀이 커버한다.

특히 PCI-DSS나 ISO27001 같은 컴플라이언스는 Couchbase가 이미 받아놨으니까, 여러분은 비즈니스 로직에만 집중하면 됨. 감사 때도 "우리 DB는 이미 인증받은 거 씁니다" 한 마디면 오케이.

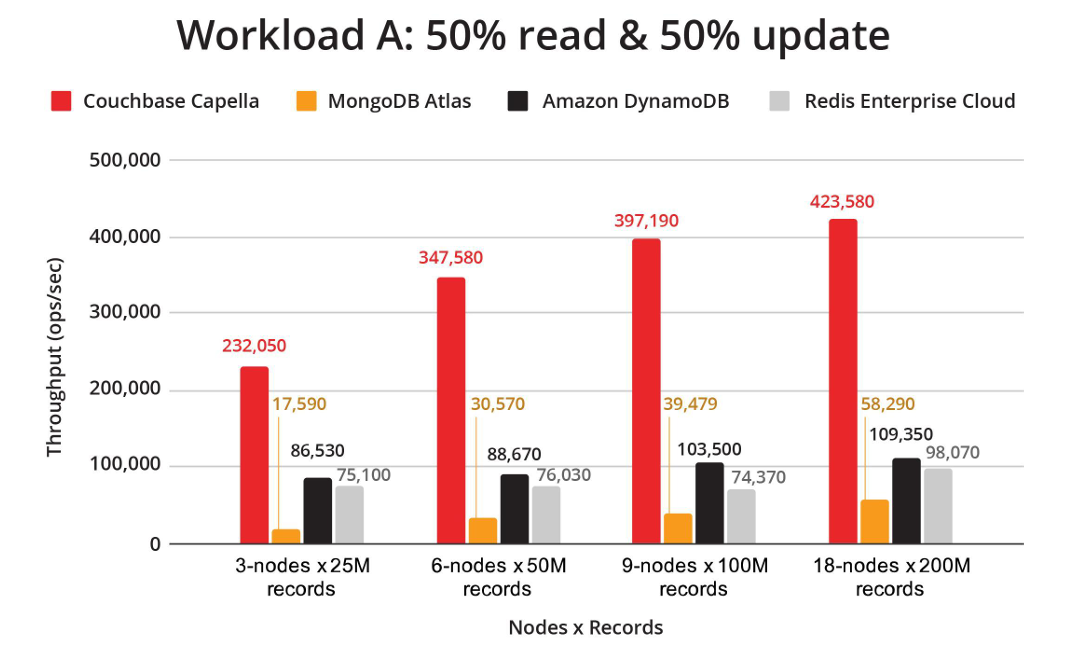

성능도 잠깐 자랑하면…ㅋㅋ

왜 지금?

금리 변동으로 핀테크 투자가 얼어붙은 상황에서, 비용 효율성 없으면 살아남기 어렵다. 그런데 AI는 포기할 수도 없는 노릇. 경쟁사가 LLM 기반 개인화 투자 조언 서비스 내놓는데, 우리만 구닥다리 엔진 쓸 순 없으니까.

Couchbase는 이 딜레마의 현실적 해답. 기존 시스템을 급작스럽게 뜯어고칠 필요 없이, 점진적으로 AI 기능을 추가하면서 동시에 비용을 줄일 수 있다.

특히 모바일 앱이 주력인 핀테크라면, 오프라인에서도 작동하는 벡터 검색이 가능한 건 (거의 유일무이) Couchbase뿐이다. 지하철에서도 "내 투자 포트폴리오 분석해줘" 질문에 즉답할 수 있는 것.

여기서 진짜 게임 체인저는 Capella AI Services다.

고객 상담 챗봇의 경우 완전히 동일한 질문이 반복되는 경우는 드물지만, 의미가 비슷한 질문들은 자주 나타남. 이때 Couchbase Capella의 Vector Search를 활용하면, 단순한 키워드 매칭이 아니라 사용자의 질문의 의도와 맥락을 이해하는 시맨틱 검색을 통해 유사한 질문과 관련된 답변을 문서에서 찾아낼 수 있음.

예를 들어, ‘배송 언제 오나요?’, ‘주문한 상품 언제 받을 수 있나요?’, ‘배송 일정이 궁금합니다’처럼 표현은 다르지만 의미가 비슷한 질문에 대해서도 적절한 문서를 찾아 연결해 줄 수 있다.

또한 Capella의 Vector Search는 RAG(Retrieval-Augmented Generation) 아키텍처에서 문서 검색을 담당하는 구성 요소로서, LLM(GPT-4 API 등)에 최신 정보와 문맥을 제공해 더 정확한 답변을 생성할 수 있도록 돕는다. 이렇게 하면 LLM이 매번 모든 정보를 생성하지 않아도 되므로, 토큰 비용을 줄이고 사용자 데이터를 효과적으로 활용할 수 있다.

추가로, 프롬프트 히스토리 저장도 가능! 고객별 대화 로그를 Capella에 저장하고 Model Service 문서를 활용하면 캐시 보존으로 컨텍스트 재활용. 그럼 고객별 대화 맥락을 유지하면서도, 이전 상호작용 데이터로 모델을 점진적으로 파인튜닝할 수 있다. 결국 자체 모델 성능이 올라가니까 외부 API 의존도가 줄어들 수 있다.

마이그레이션 : 다운타임 없이 넘어갈 수 있나?

가장 현실적인 고민이라고 생각한다. 핀테크에서 시스템 다운은 곧 매출 손실이니까.

규모나 리스크에 따라 구간별 속도가 다르지만 아래 3가지 단계별 접근 방식을 공유함.

1단계: 기존 MySQL/PostgreSQL 데이터를 Couchbase로 그대로 옮기기. 데이터 이중화 도구로 실시간 동기화 유지하면서 트래픽을 점진적으로 이전.

2단계: JSON 네이티브 구조로 스키마 최적화. 기존 정규화된 테이블들을 문서 기반으로 재설계하면서 쿼리 성능이 대폭 개선됨.

3단계(AI-강화): 벡터 검색과 AI Services 도입. 기존 엔진을 LLM 기반으로 교체하면서 진짜 지능형 서비스로 진화.

실제 마이그레이션 기간은 짧다. 금융권 특성상 검증 기간이 길어서 그렇지, 기술적으로는 훨씬 빠르다.

남들은 얼마나 잘쓰고 있니

FICO: 메모리 우선 아키텍처로 1ms 미만의 응답 시간 제공 중. 하품하고 입닫기전에 끝난다.

Wells Fargo: 하루 5천만 건 이상의 트랜잭션을 10ms 미만의 작업 시간으로 끝. 이전 시스템에서는 18%의 사기 거래를 실시간으로 처리하던 것과 비교하여 100%의 거래를 실시간으로 처리 중.

Equifax: 3억 개 이상의 문서를 40분 안에 끝내고 5ms 응답 시간을 제공 중.

FICO, Wells Fargo, Equifax 이 세 기업을 보면 공통점이 하나 있다. 바로 '실시간'이라는 키워드. 핀테크에서 1초가 늦으면 고객이 떠나고, 1ms가 늦으면 사기 거래를 놓칠 수 있다.

특히 Wells Fargo의 사례가 인상적인데, 18%에서 100%로 실시간 처리율을 끌어올린 건 단순히 기술 업그레이드가 아니라 비즈니스 워크플로우 자체를 바꾼 것. 예전엔 "일단 승인하고 나중에 확인하자"였다면, 이제는 "승인하는 그 순간에 모든 걸 다 판단하자"로 패러다임이 완전히 변화한거라고 생각한다.

카우치베이스 같은 메모리 우선 아키텍처의 진짜 가치는 '속도와 안정성에 오는 예측 가능성'에 있다. FICO가 1ms 미만을 안정적으로 유지할 수 있다는 건, 시스템이 예측 가능하다는 뜻. 핀테크에서 이런 일관성은 금값이고.

결국 이런 기업들이 선택한 건 "확실한 것"이었고, 그 투자가 고객 경험과 비즈니스 성과로 돌아온 케이스들. 엔지니어링 비용은 줄이되, 절대 타협하면 안 되는 부분은 확실히 구분한 셈이다.

엔지니어와 CFO 모두 웃게 만드는 방법

결국 핀테크에서 기술 선택은 "장기 생존"의 문제.

당장 눈앞의 기능 구현도 중요하지만, 3년 후에도 경쟁력을 유지할 수 있는 아키텍처인지가 더 중요하다. AI 시대에는 특히 그렇다.

Couchbase가 제시하는 건 단순한 데이터베이스 교체가 아니라, "적은 비용으로 더 많은 혁신을 가능하게 하는 플랫폼". 엔지니어는 복잡한 인프라 관리에서 벗어나 창의적 문제 해결에 집중할 수 있고, CFO는 예산 절감 효과를 분기 실적에 반영할 수 있을듯.

ROI 계산…그래서 우리 회사는?

더 자세한 TCO 계산이나 마이그레이션 전략이 궁금하면 메세지 주세요.

커피 한 잔 값으로 수십만 달러 절약하는 방법, 기꺼이 공유하겠습니다.